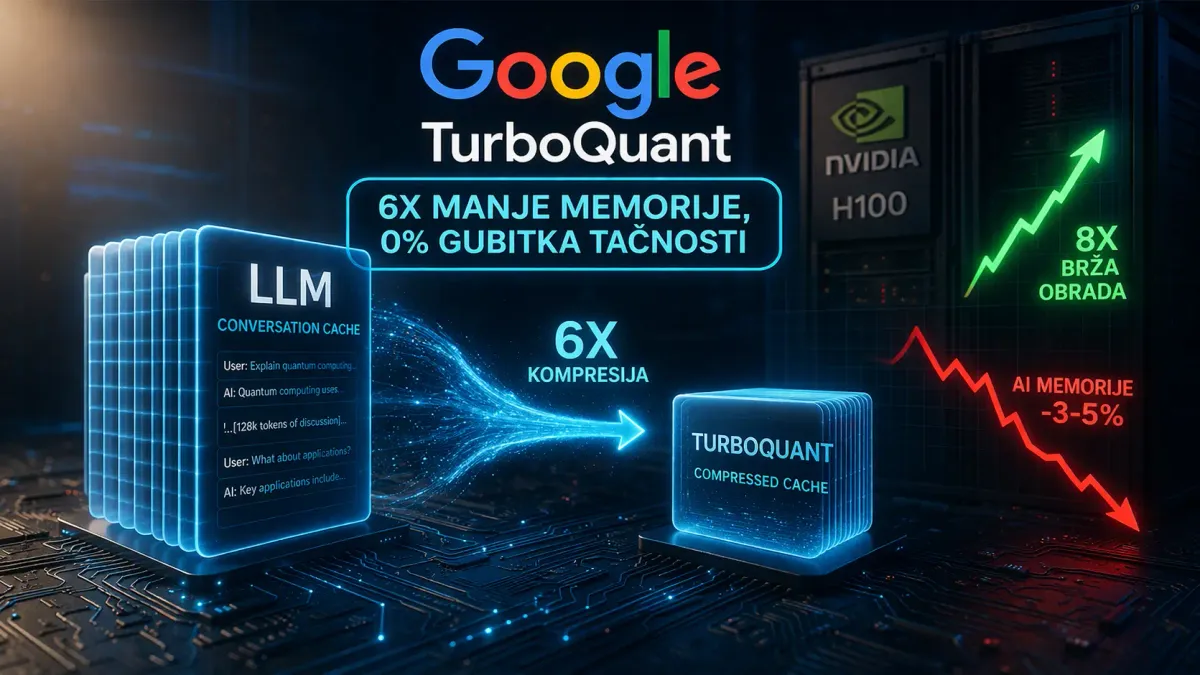

Google TurboQuant smanjuje memoriju LLM-a 6x bez gubitka tačnosti

Google Research predstavio je TurboQuant, algoritam koji kompresuje KV cache velikih jezičkih modela za najmanje 6 puta bez gubitka tačnosti. Tehnologija obećava niže troškove, bržu inferenciju i novi pritisak na AI memory sektor.

Google tvrdi da novi algoritam kompresije drastično smanjuje troškove i ubrzava rad velikih jezičkih modela, što je odmah uzdrmalo sektor AI memorije.

Google Research je 24. marta 2026. predstavio TurboQuant, novi algoritam za kompresiju koji smanjuje memorijske zahtjeve za KV cache u velikim jezičkim modelima za najmanje 6 puta, uz tvrdnju da nema gubitka tačnosti. Prema Googleu, sistem može da spusti cache na samo 3 bita po vrijednosti, bez dodatnog treniranja modela, a na Nvidia H100 akceleratorima donosi i do 8 puta brže računanje attention logita. Vijest je brzo odjeknula i na tržištu čipova.

- Google kaže da TurboQuant smanjuje KV cache memoriju za najmanje 6x bez gubitka tačnosti.

- Algoritam radi bez retreniranja ili fine-tuninga modela.

- Na Nvidia H100 akceleratorima prijavljen je i do 8x brži rad attention operacija.

- Google navodi odlične rezultate na LongBench, Needle In A Haystack, ZeroSCROLLS, RULER i L-Eval testovima.

- Objavljivanje je izazvalo pad pojedinih AI memory dionica, što pokazuje koliko je tržište osjetljivo na softverske pomake.

Analiza

TurboQuant cilja jedan od najvećih praktičnih problema savremenih LLM sistema: rast KV cache memorije tokom dužih razgovora i dužeg konteksta. Kako model obrađuje više tokena, mora da čuva sve veći trag prethodnog konteksta, što usporava inferenciju i povećava cijenu pokretanja modela. Google navodi da TurboQuant rješava taj problem kroz kombinaciju dvije tehnike: PolarQuant za visokoefikasnu kompresiju i QJL, odnosno Quantized Johnson-Lindenstrauss, za korekciju preostale greške.

Najvažnija tvrdnja je da se KV cache može kompresovati na 3 bita bez kompromisa po pitanju tačnosti i bez retreniranja. To je važno jer je upravo retreniranje ili dodatna adaptacija često prepreka za brzo uvođenje novih optimizacija u produkciju. Google takođe tvrdi da je implementacija lagana i da uvodi zanemarljiv dodatni trošak tokom rada.

U testovima dugog konteksta, uključujući Needle In A Haystack, Google navodi savršene rezultate uz najmanje 6x manju memoriju. U praksi to znači da modeli mogu da zadrže duži kontekst uz manji hardverski pritisak ili da na istoj infrastrukturi opsluže više korisnika. Dodatno, Google tvrdi da 4-bit TurboQuant na H100 GPU-u postiže i do 8x ubrzanje u računanju attention logita u odnosu na 32-bitne nekompresovane ključeve.

Google isti pristup pozicionira i šire od samih chatbotova. Firma navodi da je TurboQuant koristan i za vektorsku pretragu, gdje je u internim evaluacijama nadmašio referentne metode poput PQ i RabbiQ po recall metrikama, uprkos efikasnijem kodiranju i bez teškog podešavanja za specifične skupove podataka.

Konkurencija i tržište

Ovdje je važno spustiti loptu. Jedan rad ne znači da će potražnja za HBM memorijom ili AI akceleratorima naglo pasti preko noći. Najveći modeli i dalje troše ogromne količine memorije, a realni produkcioni sistemi imaju i druge uska grla propusnost mreže, orkestraciju, cijenu GPU vremena, raspodjelu opterećenja i latenciju na nivou cijelog sistema.

Ipak, reakcija tržišta pokazuje da investitori više ne gledaju samo sirovu hardversku potražnju, nego i rizik da dio vrijednosti prebaci pametniji softver. Wall Street Journal je izvijestio da je Micron pao 3,4 posto, dok su neke druge memorijske i storage firme pale više od 6 posto nakon što je Google objavio TurboQuant. To je signal da tržište sve ozbiljnije cijeni scenario u kojem algoritamska efikasnost smanjuje premiju koju danas ima AI memorijski hardver.

Važan detalj je i akademska legitimacija. Google Research navodi da će TurboQuant biti predstavljen na ICLR 2026, a ICLR-ova zvanična lista radova za 2026. zaista sadrži rad “TurboQuant: Online Vector Quantization with Near-optimal Distortion Rate”. To ne garantuje komercijalni uspjeh, ali daje dodatnu težinu cijeloj priči.

Naša perspektiva

Za firme i timove u regionu koji koriste AI za posao, TurboQuant je važniji kao signal nego kao gotov proizvod koji će sutra svi uključiti jednim klikom.

Prvo, ovo potvrđuje da će naredna faza AI tržišta biti borba za efikasnost, a ne samo za veće modele. To znači da će poslovni korisnici sve više pitati koliko košta obrada dugog konteksta, koliko korisnika može stati na istu infrastrukturu i koliko brzo sistem vraća odgovor.

Drugo, regionalne firme koje razvijaju AI agente, interne asistente, dokumentne pretrage i RAG sisteme mogu dugoročno profitirati od ovakvih pristupa. Ako se slične tehnike brzo preliju u open-source ekosistem i komercijalne serving platforme, biće moguće nuditi duže kontekste i niže troškove bez proporcionalnog rasta ulaganja u GPU memoriju.

Treće, ovo povećava pritisak na cloud provajdere i AI platforme da korisnicima ne prodaju samo “više hardvera”, nego bolju optimizaciju. Za poslovne korisnike u BiH i regionu to je dobra vijest: tržište ide ka tome da efikasniji softver obara cijenu po korisnom AI zadatku.

Zaključak

TurboQuant ne ruši AI memory tržište preko noći, ali mijenja ton cijele industrije. Ako se Googleove tvrdnje potvrde i u široj produkciji, fokus bi mogao da se pomjeri sa pukog gomilanja memorije na pametniju kompresiju i efikasnije inferencijske sisteme. Najrealnije predviđanje je da ćemo u narednih 12 mjeseci vidjeti talas sličnih tehnika u LLM infrastrukturi, a pobjednici neće biti samo proizvođači čipova nego i firme koje znaju da spoje hardver i algoritamsku optimizaciju u isplativ proizvod.

Google tvrdi da novi algoritam kompresije drastično smanjuje troškove i ubrzava rad velikih jezičkih modela, što je odmah uzdrmalo sektor AI memorije.