Sam Altman pod novom lupom: istraga New Yorkera otvara stara pitanja

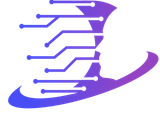

Opširna istraga New Yorkera donosi dosad najdetaljniji prikaz optužbi o Samu Altmanu, od Sutskeverovih memoranduma do pitanja bezbjednosti, povjerenja i upravljanja u OpenAI-ju.

Opširna istraga Ronana Farrowa i Andrewa Marantza donosi dosad najdetaljniji prikaz optužbi o načinu na koji Sam Altman vodi OpenAI, baš u trenutku kada firma od svijeta traži povjerenje za razvoj superinteligencije.

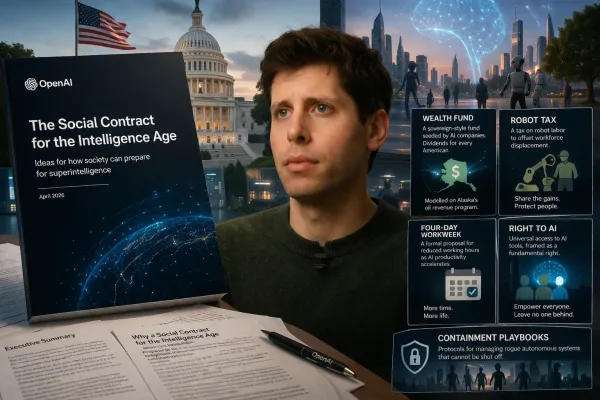

OpenAI je ponovo u centru rasprave o povjerenju, upravljanju i bezbjednosti vještačke inteligencije nakon što je The New Yorker 6. aprila 2026. objavio veliku istragu o Samu Altmanu. Tekst se oslanja na više od 100 intervjua, ranije neobjavljene interne dokumente i privatne bilješke ljudi koji su godinama bili blizu vrha kompanije. U središtu priče nije jedan spektakularan incident, nego obrazac ponašanja koji, prema sagovornicima i dokumentima, traje još od Altmanovih ranijih poslovnih faza, a posebno dolazi do izražaja u OpenAI-ju. Altman je za The New Yorker osporio ili ublažio više navoda iz istrage.

- Istraga The New Yorkera tvrdi da su pojedini bivši i sadašnji saradnici Sama Altmana godinama sumnjali u njegovu iskrenost i način upravljanja OpenAI-jem.

- Prema objavljenim detaljima, Ilya Sutskever je 2023. sastavio tajne memorandume zasnovane na desetinama stranica Slack poruka i HR materijala, uz tvrdnju da je Altman pogrešno predstavljao bezbjednosne procedure odboru.

- U tekstu se navodi i da su privatne bilješke Daria Amodeija, danas direktora Anthropica, nezavisno došle do sličnog zaključka: da je problem u samom vrhu upravljanja.

- Posebno je sporno to što interna revizija nakon Altmanovog kratkog izbacivanja iz OpenAI-ja 2023. nije završila javno dostupnim pisanim izvještajem.

- Priča dolazi u trenutku kada su OpenAI i Anthropic u otvorenoj borbi za enterprise tržište, kapital i politički uticaj, pa pitanja upravljanja više nisu samo reputacioni problem nego i poslovni rizik.

Analiza: Šta je zapravo otkrila istraga

Najozbiljniji dio istrage odnosi se na memorandume Ilye Sutskevera iz jeseni 2023. The New Yorker navodi da su ti materijali sastavljeni iz oko 70 stranica Slack poruka i HR dokumenata, te da su poslani drugim članovima odbora kao nestajuće poruke. Prema tekstu, jedan memorandum počinje formulacijom da Sam Altman pokazuje “dosljedan obrazac”, a prva stavka na listi je “laganje”. U istom paketu navodno su bili i navodi da je Altman pogrešno predstavljao činjenice rukovodiocima i članovima odbora, uključujući pitanja internih bezbjednosnih procedura.

Istraga dodatno opisuje da je odbor OpenAI-ja u novembru 2023. javno rekao da Altman “nije bio dosljedno otvoren u komunikaciji”, ali bez detaljnog objašnjenja. To je tada ostavilo prostor da investitori, partneri i javnost nagađaju da li je riječ o krivičnom djelu, ličnom skandalu ili upravljačkom sukobu. Po tekstu The New Yorkera, fokus ljudi koji su ga pokušali smijeniti bio je prije svega na integritetu i povjerenju, a ne na jednom pojedinačnom incidentu.

Drugi važan sloj priče čine privatne bilješke Daria Amodeija, bivšeg istraživačkog lidera OpenAI-ja i današnjeg prvog čovjeka Anthropica. U članku se navodi da je Amodei godinama vodio detaljne privatne zapise o ponašanju Altmana i Grega Brockmana, te da su ti dokumenti kasnije kružili među ljudima iz Silicijumske doline. Po toj verziji događaja, Amodei je rano zaključio da je osnovni problem u OpenAI-ju upravo način na koji Altman vodi organizaciju.

Tekst takođe povlači liniju unazad, do Loopt-a i Y Combinatora, sugerišući da se slične sumnje prema Altmanovom stilu upravljanja nisu pojavile tek sa ChatGPT erom. The New Yorker navodi da su i ranije postojali sukobi oko povjerenja, političkog manevrisanja i kontrole narativa, što pojačava utisak da se ne radi o kratkoročnoj internoj svađi nego o obrascu koji prati cijelu karijeru.

Posebno je osjetljiv dio istrage koji se bavi bezbjednošću modela. Članak tvrdi da su pojedini članovi odbora i istraživači vjerovali da Altmanove navodne nedosljednosti nisu samo problem korporativne kulture, nego nešto što može imati posljedice po bezbjednost proizvoda. Kao primjer se navodi epizoda iz 2022. kada je odboru rečeno da su određene funkcije GPT-4 prošle potrebna odobrenja, dok je kasnije utvrđeno da neke od najspornijih funkcija nijesu formalno odobrene na način na koji je predstavljeno.

Konkurencija i tržište: Zašto ova priča ima veću težinu nego ranije

Ova istraga ne dolazi u praznom prostoru. OpenAI je prije samo nekoliko dana objavio da je zatvorio novu rundu finansiranja od 122 milijarde dolara uz post-money valuaciju od 852 milijarde dolara, što pokazuje koliko je firma postala centralna za cijeli AI sektor. Upravo zato pitanja upravljanja više nijesu samo interna stvar, nego pitanje povjerenja investitora, regulatora i velikih poslovnih korisnika.

Istovremeno, Anthropic je u februaru 2026. podigao novu rundu koja ga je procijenila na 380 milijardi dolara, a Reuters je u martu izvijestio da su OpenAI i Anthropic u direktnoj borbi za enterprise klijente i partnerstva sa private equity fondovima. Drugim riječima, vodeće AI firme više se ne takmiče samo modelima, nego i time ko djeluje stabilnije, predvidljivije i sigurnije za velike organizacije.

U tom kontekstu, New Yorkerova priča pogađa samu srž OpenAI-jevog brenda. Firma je izgrađena na ideji da razvija izuzetno moćnu tehnologiju uz posebne zaštitne mehanizme i neobičnu upravljačku strukturu. Međutim, istraga tvrdi da su ti mehanizmi vremenom oslabili: ljudi koji su učestvovali u Altmanovom izbacivanju izgubili su mjesta u odboru, a naknadna nezavisna provjera nije rezultirala formalnim pisanim izvještajem. The New Yorker piše da je u martu 2024. OpenAI objavio sažeto saopštenje o “slomu povjerenja”, ali ne i puni dokument nalaza.

Dodatni problem za OpenAI je što je konkurencija danas snažnija nego 2023. Reuters navodi da se utrka sa Anthropicom vodi upravo oko unosnih poslovnih korisnika, dok tržište istovremeno postaje osjetljivije na troškove, infrastrukturu i pitanja korporativne kontrole. Kada je proizvod obećanje o “sigurnoj superinteligenciji”, reputacioni udar na vrhu firme može direktno uticati na prodaju, partnerstva i regulatorni tretman.

Naša perspektiva: Šta ovo znači za firme i korisnike u regionu

Za poslovne korisnike u Bosni i Hercegovini i regionu, ova priča je važna iz jednog jednostavnog razloga: većina kompanija danas ne kupuje samo model, nego dugoročno povjerenje u dobavljača AI infrastrukture. Ako se interno upravljanje u vodećim AI firmama dovodi u pitanje, onda se mijenja i procjena rizika za firme koje planiraju osloniti prodaju, korisničku podršku, analitiku, razvoj softvera ili automatizaciju na te platforme.

To ne znači da će kompanije u regionu prestati koristiti OpenAI. Naprotiv, OpenAI je i dalje jedan od najjačih igrača na tržištu i ima ogroman kapital, globalni domet i snažan proizvodni ekosistem. Ali ova priča pokazuje da firme moraju ozbiljnije razmišljati o vendor lock-inu, internim pravilima korištenja AI alata, pravnim obavezama i rezervnim opcijama prema konkurentima poput Anthropica ili Googlea.

Za domaće IT firme, agencije i korporacije koje uvode AI u svakodnevni rad, ključna lekcija je da governance više nije apstraktna tema za američke odbore. Ako je dobavljač pod pritiskom zbog pitanja iskrenosti prema sopstvenom odboru ili nedovoljno jasnih bezbjednosnih procedura, to može uticati na tempo razvoja proizvoda, uslove korištenja, cijene, partnerstva i regulatorne obaveze. Drugim riječima, “ko vodi AI firmu” postaje skoro jednako važno kao i “koliko je model dobar”.

Posebno za kompanije koje koriste AI u osjetljivim sektorima, poput finansija, zdravstva, telekoma ili javne uprave, ovakve priče su signal da moraju tražiti više dokumentacije, jače ugovorne garancije i jasniju revizijsku sljedivost. U regionu se često fokus stavlja na brzinu uvođenja alata, ali 2026. godina sve više pokazuje da će pobjednici biti oni koji spoje produktivnost i upravljanje rizikom.

Zaključak

Najvažniji efekat ove istrage vjerovatno neće biti trenutni pad OpenAI-ja, nego dugotrajnije slabljenje narativa da je dovoljno vjerovati viziji jednog čovjeka. Ako se u narednim mjesecima dodatno pojačaju regulatorni pritisci, sudski sporovi i tržišna borba sa Anthropicom, pitanje governancea moglo bi postati glavni kriterij po kojem će veliki kupci birati AI partnere. To je loša vijest za OpenAI ako ne ponudi uvjerljiviji odgovor od dosadašnjih demantija, ali i dobra vijest za tržište ako natjera cijelu industriju da ozbiljnije tretira odgovornost na vrhu. Ovo izgleda kao početak nove faze AI utrke, u kojoj sama tehnička superiornost više neće biti dovoljna.