Kada AI kaže “ne” Pentagonu. Anthropic rekao ne vojnom vrhu

Anthropic je povukao crvenu liniju prema Pentagonu. Reakcija je bila brza i oštra. Ovo nije samo spor oko ugovora, već test da li AI kompanije zaista mogu reći “ne” državi.

U trenutku kada se vještačka inteligencija sve više ugrađuje u državne sisteme, od poreskih uprava do vojnih operacija, pitanje više nije može li AI pomoći državi. Pitanje je može li joj ikada reći ne.

Godinama je industrija uvjeravala Washington da regulacija nije potrebna jer će se kompanije same kontrolisati. Taj argument sada prolazi svoj prvi ozbiljan stres test. I nije riječ o akademskoj raspravi, već o ratnim zonama, obavještajnim analizama i granicama koje neko mora povući.

Šta se zapravo desilo

Anthropic je prošlog četvrtka javno saopštio da njegov model Claude ne smije biti korišten za masovni nadzor američkih građana niti za potpuno autonomno oružje bez ljudske kontrole. To je bio jasan uslov u okviru postojećeg ugovora sa Pentagonom vrijednog oko 200 miliona dolara. O ovome smo pisali prošle sedmice možete pročitati u članku:

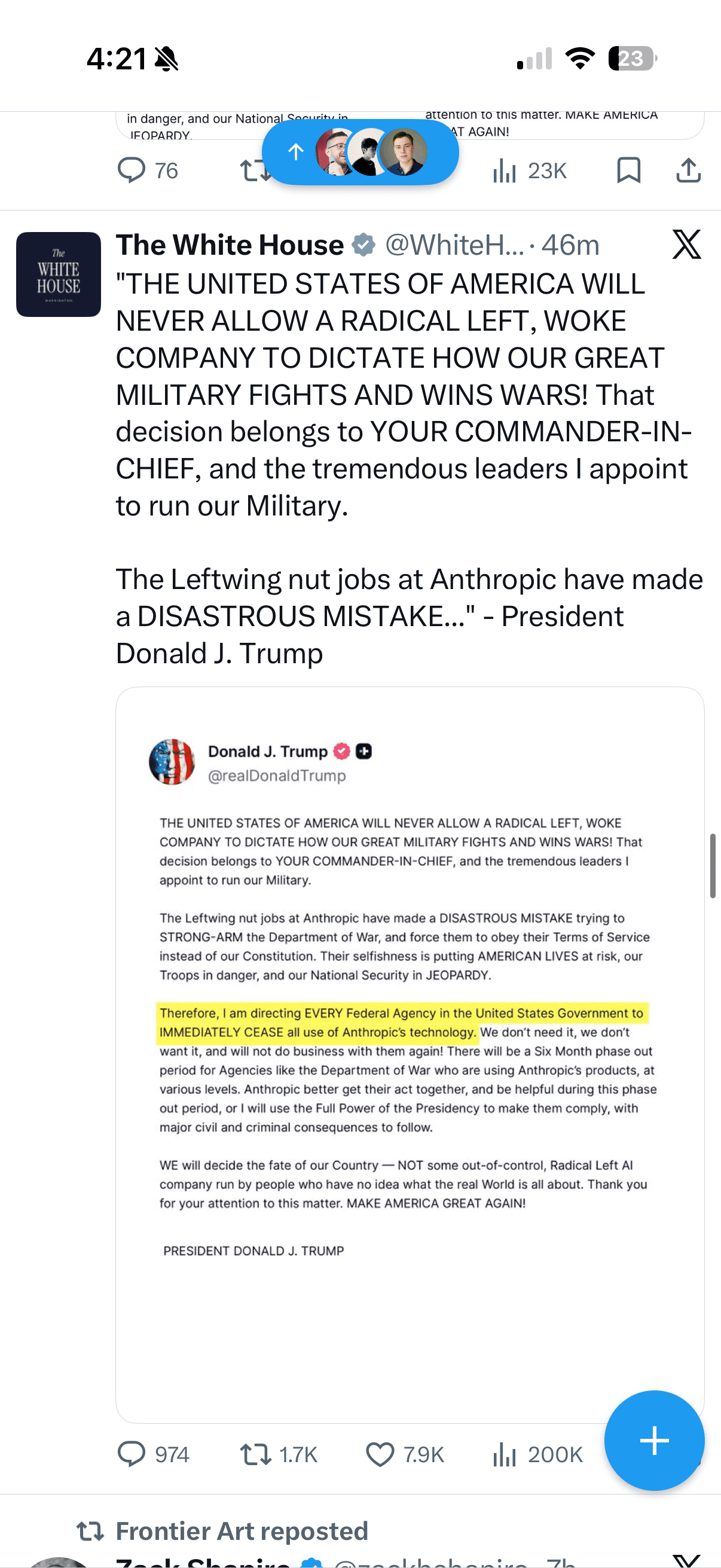

Do petka uveče, administracija predsjednika Donald Trump naložila je federalnim agencijama da obustave korištenje njihove tehnologije. Pentagon je otišao i korak dalje, označivši kompaniju kao “rizik u lancu snabdijevanja za nacionalnu bezbjednost”, termin koji se inače koristi za kompanije poput Huawei. Ozbiljan pristisak i želi da se pošalje signal ostalima kako će da završe ako se suprostavljaju.

Pozadina sukoba je precizna. Ministarstvo odbrane tražilo je pristup za “sve zakonite svrhe”. Anthropic je pristao osim u dvije tačke: nema masovnog prikupljanja geolokacijskih, finansijskih i podataka o pretraživanju Amerikanaca putem data brokera, i nema sistema koji samostalno odlučuje kada će nešto ispaliti bez čovjeka u lancu odlučivanja.

Prema navodima iz medija, ponuđeni “kompromis” sadržavao je rupe koje bi omogućile da se te zaštite zaobiđu. Izvršni direktor Dario Amodei odbio je potpis.

Satima nakon što je vlada krenula protiv Claudea, pojavljuje se novi obrt. OpenAI objavljuje sopstveni ugovor s Pentagonom. Sam Altman tvrdi da sporazum uključuje iste dvije crvene linije, uz treću: zabranu AI sistema za društveni kredit. Međutim, pojedini zvaničnici su kontrirali toj interpretaciji, navodeći da će OpenAI dozvoliti “sve zakonite svrhe”.

U međuvremenu, više od 300 zaposlenih u Google i preko 60 radnika OpenAI-ja potpisalo je otvoreno pismo tražeći da njihove firme povuku iste granice kao Anthropic.

I da, dok je zabrana još bila svježa, američka vojska je navodno koristila Claude za obavještajne procjene i simulacije tokom vazdušnih udara na Iran. Dakle, scenario nije hipotetički. Pisali smo i na ovu temu, detalje možete pročitati u članku:

Zašto je ovo uopšte bitno

Ovo nije spor oko jedne klauzule u ugovoru. Ovo je sudar dva koncepta suvereniteta.

Prvi kaže: država ima pravo da koristi sve zakonite alate za nacionalnu bezbjednost.

Drugi kaže: kompanija koja razvija tehnologiju ima pravo da ograniči način na koji se ta tehnologija koristi, čak i kada je kupac država.

Industrija vještačke inteligencije godinama je izbjegavala regulaciju pod argumentom samoregulacije. Sada prvi put vidimo šta to znači u praksi. Kada Pentagon kaže “sve zakonite svrhe”, da li to podrazumijeva i moralnu saglasnost proizvođača?

Ako kompanije pristanu na sve, onda su njihove etičke smjernice samo marketing. Ako odbiju, rizikuju da budu označene kao prijetnja nacionalnoj bezbjednosti.

To je presedan.

Šta se previđa u javnoj priči

U medijima se sukob predstavlja kao drama između Bijele kuće i jedne AI firme. Ali tiha pretpostavka je da je “zakonito” dovoljno.

Istorija američke bezbjednosne politike pokazuje da se pojam zakonitog širi i sužava u zavisnosti od političkog trenutka. Kada kompanija potpiše klauzulu o “svim zakonitim svrhama”, ona praktično prepušta definiciju svojih etičkih granica nekom drugom.

Druga stvar koja se rijetko naglašava: tehnološke kompanije više nisu samo dobavljači softvera. One su infrastruktura. A infrastruktura koja može reći “ne” državi mijenja odnos moći.

Treće, tu je unutrašnji pritisak zaposlenih. Otvorena pisma nisu PR trik. To je signal da radna snaga u AI sektoru ne želi da bude pasivni izvođač državnih politika.

Šira slika

Ovaj sukob dolazi u trenutku kada vještačka inteligencija prelazi iz faze eksperimenta u fazu implementacije u stvarne, visoko rizične sisteme. Godinama su kompanije lobirale protiv stroge regulacije, tvrdeći da će same postaviti granice.

Sada se vidi koliko je to održivo kada je kupac najmoćnija država na svijetu.

Ako Anthropic uspije da pravno ospori oznaku “rizika”, otvoriće prostor da i druge kompanije postavljaju uslove državi. Ako ne uspije, poruka će biti jasna: u nacionalnoj bezbjednosti nema privatne savjesti.

I tada više nećemo govoriti o etičkim smjernicama AI kompanija, već o njihovoj spremnosti da ih žrtvuju.

Možda je pravo pitanje manje pravno, a više filozofsko: ako pojedinac može biti prigovarač savjesti u ratu, da li to može biti i kompanija ili je ta ideja rezervisana samo za ljude.