Kad počnemo da zvučimo kao ChatGPT

Istraživanje pokazuje da spontani govor sve više liči na jezik chatbotova. To nije samo stil, već zatvorena povratna petlja koja može promijeniti budućnost modela.

Jezik se uvijek mijenjao pod uticajem tehnologije. Telefon je ubrzao rečenice. Televizija je pojednostavila ton. Društvene mreže su ga isparcelisale u kratke, udarne fragmente. Ali sada se dešava nešto suptilnije i, možda, dublje.

Ne prilagođavamo samo stil mediju. Počinjemo da prilagođavamo sopstveni govor modelima koje smo sami napravili.

Tim sa Max Planck Institute analizirao je 740.000 sati akademskih predavanja i podcasta na YouTubeu i uočio nagli skok u upotrebi riječi koje veliki jezički modeli preferiraju. Ne u tekstovima koje je generisala vještačka inteligencija. Već u spontanom, živom govoru ljudi.

I to je suštinski drugačija vijest.

Šta se zapravo desilo

Istraživači su pratili promjene u govoru nakon lansiranja OpenAI-jevog ChatGPT-a. Posebno su gledali frekvenciju riječi koje modeli često koriste jer su “neutralne”, “akademske” i “sigurne”.

Rezultat je bio iznenađujuće jasan.

Upotreba riječi poput “delve” porasla je za 48 odsto, a “adept” za 51 odsto u govornim formatima neposredno nakon pojave ChatGPT-a. Oko 58 odsto tih primjera dolazi iz neskriptovanih situacija, što sugeriše da ljudi ne čitaju AI tekst. Oni su ga usvojili.

To znači da latentni prostor modela statistički pejzaž vjerovatnih riječi počinje da oblikuje našu intuitivnu leksiku.

Zašto je ovo uopšte bitno

Dugo smo raspravljali o tome da li će vještačka inteligencija pisati umjesto nas. Mnogo manje smo se pitali da li ćemo početi da govorimo kao ona.

U STEM i biznis okruženju, gdje je pritisak da zvučite profesionalno konstantan, neutralni i “uglancani” ton chatbotova postaje bezbjedna opcija. Niko vas neće kritikovati što zvučite previše precizno. Ili previše odmjereno. Ili previše generički.

Ali upravo ta generičnost je problem.

Ako ljudi preuzmu stil koji je dizajniran da minimizira rizik, humor, lokalne idiome i emocionalnu teksturu, onda modeli budućnosti neće trenirati na bogatom, raznolikom jeziku. Treniraće na već obrađenoj verziji sopstvenog izlaza.

Šta se previđa u javnoj priči

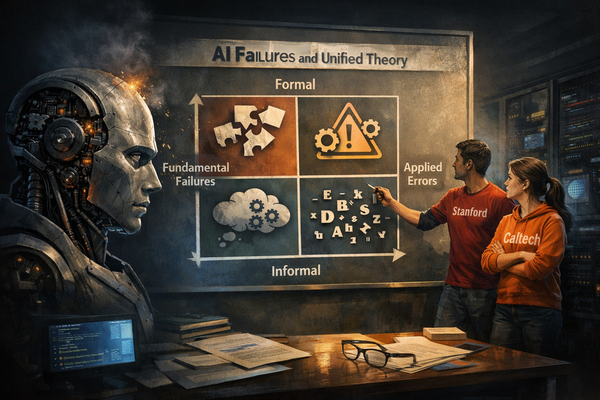

U javnim debatama često se govori o “model collapse” scenariju u kojem AI sistemi degradiraju jer se hrane sopstvenim generisanim sadržajem. Ali sada ulazimo u sofisticiraniju verziju tog problema.

Ne treniraju se modeli na direktno kopiranim AI tekstovima. Već na ljudima koji su nesvjesno internalizovali AI stil. To je daleko teže detektovati.

Jer više ne postoji jasna linija između “autentičnog” i “generisanog”. Ako 58 odsto novih obrazaca dolazi iz spontanog govora, onda ne možemo jednostavno filtrirati AI sadržaj. AI je već ušao u kognitivni proces izbora riječi.

Drugim riječima, nije riječ o plagijatu. Riječ je o imitaciji bez namjere.

Šira slika

Ovo nije samo lingvistička kurioziteta. Ovo je promjena u smjeru kulturnog uticaja.

Tehnološke kompanije su dugo oblikovale načine na koje komuniciramo kroz algoritme, interfejse i ograničenja formata. Ali sada modeli postaju kulturni standard profesionalnog govora. Ne nameću se kroz cenzuru ili pravila, nameću se kroz praktičnost.

Ako chatbot zvuči “pametan”, mi taj ton preuzimamo da bismo i sami zvučali pametno. Ako zvuči odmjereno, mi ublažavamo sopstvene ekscese. Ako izbjegava rizik, mi postajemo oprezniji.

To je gotovo savršena asimilacija.

U trenutku kada mašine više ne samo da generišu tekst, već oblikuju naš spontan govor, pitanje više nije ko koga trenira. Već koliko dugo ćemo primjećivati razliku.

Možda model kolapsa neće izgledati kao tehnička greška, već kao svijet u kojem svi zvuče pomalo isto.