Kad kopiraš budućnost: AI rat koji je već počeo. Anthropic uhvatio kineske modele kako kopiraju Cloude

U AI trci više se ne krade kod, već sposobnost modela. Optužbe o destilaciji Claud-a otvaraju pitanje koliko je inteligencija uopšte moguće zaštititi.

U trenutku kada se globalna AI trka sve manje vodi kroz konferencijske prezentacije, a sve više kroz infrastrukturu, podatke i tihe tehničke operacije, postaje jasno da najveće borbe više nisu oko toga ko ima bolji demo.

One su oko toga ko kontroliše znanje.

Američke i kineske laboratorije već mjesecima pokušavaju dokazati da mogu graditi modele na samom rubu mogućeg. Ali kako se jaz između lidera i onih koji ih sustižu smanjuje, pitanje više nije samo ko inovira već ko kopira, i koliko sofisticirano.

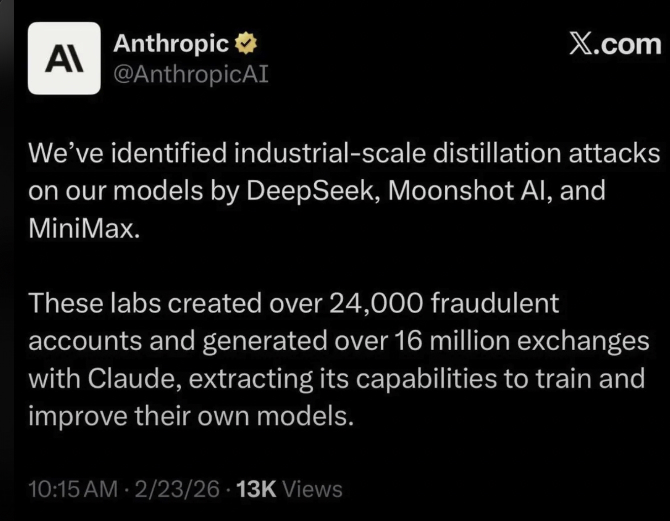

Šta se zapravo desilo

Anthropic je javno optužio tri kineske AI laboratorije DeepSeek, Moonshot AI i MiniMax da su koordinisano pokušale da “destiluju” Claude model kroz masovne, lažne korisničke naloge.

Prema njihovim navodima, operacija je uključivala više od 16 miliona interakcija raspoređenih preko 24.000 lažnih naloga.

Najveći dio kampanje, navodno, vodio je MiniMax sa preko 13 miliona razmjena. Anthropic tvrdi da su ih uhvatili usred operacije i da su primijetili kako se fokus napada prebacio na novu verziju modela u roku od 24 sata od njenog izlaska.

DeepSeek je, prema tim tvrdnjama, tražio od Claudea da eksplicitno razlaže svoje logičke korake i preformuliše politički osjetljiva pitanja što je idealan materijal za treniranje slabijeg modela i u logičkom rezonovanju i u cenzorskim mehanizmima.

Destilacija u AI svijetu nije nova stvar. Ona je tehnička praksa u kojoj se manji model trenira na izlazima većeg modela. Problem je kada to radite bez dozvole, sistematski i kroz lažne naloge.

Zašto je ovo uopšte bitno

Ovo nije samo priča o kopiranju. Ovo je priča o tome koliko je teško zaštititi “inteligenciju” kada je ona dostupna kroz API. Veliki modeli su danas komercijalni proizvodi. Ali svaki odgovor koji generišu je, u suštini, i potencijalni trening primjer za nekog drugog.

Ako kineske laboratorije zaista koriste zapadne modele da ubrzaju sopstveni razvoj, onda se tehnološka trka pretvara u nešto što više liči na hladnoratovsku špijunažu nego na tržišnu konkurenciju.

Istovremeno, ironično je da dolazi do moralne panike oko “krađe modela” u industriji koja se još uvijek suočava sa tužbama zbog načina na koji je sama prikupljala podatke za treniranje. I tu leži suštinski paradoks.

Šta se previđa u javnoj priči

Lako je priču svesti na geopolitičku napetost: Amerika protiv Kine, Claude protiv DeepSeeka. Ali važnija stvar je tehnička realnost. Ako je destilacija moguća u ovoj mjeri 16 miliona interakcija onda to znači da modeli nemaju stvarnu zaštitu od eksploatacije kroz sopstvene izlaze. Drugim riječima, API je istovremeno proizvod i ranjivost.

Takođe, javnost možda neće imati mnogo simpatije. Jer kada kompanije koje su trenirale modele na ogromnim količinama javnog i polu-javnog sadržaja sada govore o “krađi”, granica između legitimnog učenja i neovlaštenog kopiranja postaje zamagljena.

Industrija sada traži zaštitu za sebe u sistemu koji je izgrađen na ideji da je znanje skalabilno i prenosivo.

Šira slika

Ovo dolazi samo nekoliko sedmica nakon što je OpenAI pred američkim Kongresom upozorio na slične obrasce pokušaja ekstrakcije modelskih sposobnosti.

Poruka je jasna: vodeće AI kompanije žele koordinisanu reakciju i industrijsku i državnu. To znači da AI više nije samo tehnološko pitanje, već regulatorno i bezbjednosno.

Ako se potvrdi da su napredni modeli zaista ubrzano kopirani kroz sistematsku destilaciju, to bi moglo promijeniti način na koji se modeli nude javnosti. Manje otvoreni API-jevi. Strože kontrole. Više zatvorenih sistema, i možda sporiji napredak.

Jer kada znanje postane roba, prva stvar koju tržište nauči jeste kako da ga replicira.

Naš zaključak

Možda je najveća promjena u ovoj priči to što AI laboratorije više ne štite samo kod već pokušavaju da zaštite inteligenciju samu. A to je mnogo teži zadatak.