AI rješava olimpijske zadatke, ali ne zna koliko je sati

Gemini osvojio zlatnu medalju iz matematike. Isti modeli čitaju analogni sat tačno u 50,1% slučajeva. Novo istraživanje: AI zna odgovore ali ne razumije pitanja. Šta to znači za vas koji se oslanjate na AI za odluke?

Gemini osvojio zlatnu medalju na Međunarodnoj matematičkoj olimpijadi. Isti modeli tačno čitaju analogni sat samo u 50,1% slučajeva. Novo istraživanje kaže: AI zna odgovore, ali ne razumije pitanja.

Dva istraživanja objavljena u aprilu 2026. otkrivaju paradoks koji bi trebao zabrinuti svakoga ko se oslanja na AI sisteme za ozbiljne odluke. Prvo: istraživači su pokazali da AI model koji je navodno simulirao ljudsko razmišljanje zapravo ne razumije pitanja koja mu se postavljaju, samo prepoznaje obrasce i "memorira" formate odgovora. Drugo Stanford AI Index 2026 bilježi da je Gemini Deep Think osvojio zlatnu medalju na Međunarodnoj matematičkoj olimpijadi, ali da isti top AI modeli tačno čitaju analogni sat samo u 50,1% slučajeva. Zlatna medalja iz matematike, ali bacanje novčića kad treba reći koliko je sati.

- Novo istraživanje: AI model Centaur "zna" odgovore ali ne razumije pitanja koja mu se postavljaju

- Model memoriše obrasce iz trening podataka umjesto da zaista razumije jezički kontekst

- Stanford AI Index 2026: Gemini Deep Think osvojio zlatnu medalju na Matematičkoj olimpijadi

- Isti top modeli tačno čitaju analogni sat u samo 50,1% slučajeva

- Istraživači ovo nazivaju "jagged frontier", nazubljena granica sposobnosti

- Implikacija: AI može biti briljantno tačan u jednom domenu i potpuno nesposoban u drugom

Student koji se nauči za ispit, ali ne razumije materiju

Istraživanje objavljeno krajem aprila analiziralo je AI model Centaur, koji je bio predstavljen kao sistem sposoban da simulira ljudsko razmišljanje kroz 160 različitih kognitivnih zadataka. Zvučalo je impresivno. Ali kad su istraživači dublje pogledali, otkrili su fundamentalni problem.

Model nije "razmišljao". Memorisao je obrasce. Konkretno, nije razumio namjeru iza pitanja, čak ni kad je davao tačne odgovore. Istraživači to porede sa studentom koji postiže visoke ocjene tako što memorira formate testova bez stvarnog razumijevanja materijala.

Najveća slabost: razumijevanje jezika. Model se muči da prepozna šta se zapravo pita, čak i kad na osnovu prepoznatog obrasca može ponuditi "tačan" odgovor. To je zabrinjavajuće jer pokazuje da tačnost odgovora nije garancija razumijevanja.

Zlatna medalja i bacanje novčića

Stanford AI Index 2026 dodaje još jedan sloj ovom paradoksu sa konkretnim primjerom koji je istovremeno impresivan i apsurdan.

Gemini Deep Think, Google-ov napredni model, zvanično je postigao standard zlatne medalje na Međunarodnoj matematičkoj olimpijadi. Rješava najteže matematičke probleme na planeti, zadatke na kojima se godišnje kvalifikuju samo najbolji srednjoškolci iz cijelog svijeta.

Isti tip modela, kad mu pokažete sliku analognog sata i pitate koliko je sati, pogađa tačno u 50,1% slučajeva. To je statistički identično bacanju novčića. Doslovno: nasumično pogađanje bi dalo isti rezultat.

Istraživači ovo nazivaju "jagged frontier", nazubljena granica. AI sposobnosti nisu ravnomjerne. Model može biti na nivou najboljeg matematičara na svijetu u jednom zadatku i na nivou nasumičnog pogađanja u drugom. I nema načina da unaprijed znate u kojem ste dijelu granice.

Zašto ovo nije samo akademska zanimljivost

"Black box" priroda AI modela znači da ne možete znati kako su došli do odgovora. Kad model da tačan odgovor, ne znate da li je "razumio" pitanje ili je samo prepoznao obrazac iz treninga. A kad da pogrešan, ne znate zašto.

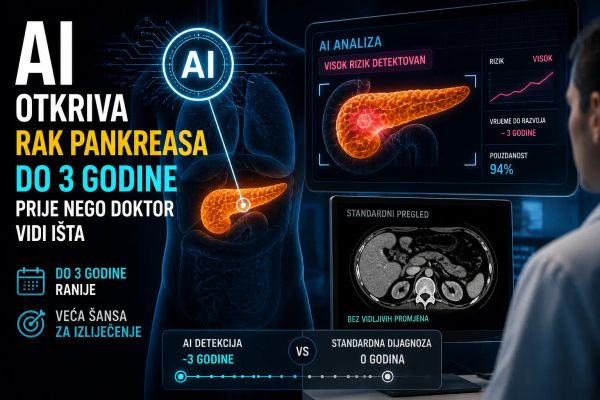

Za oblast poput matematike, ovo je manje problematično. Odgovor je ili tačan ili nije, možete ga provjeriti. Ali za oblasti gdje je kontekst bitan, pravo, medicina, poslovna strategija, rizik je ogroman. AI koji daje uvjerljiv odgovor bez razumijevanja pitanja može biti opasniji od AI-ja koji očigledno griješi.

Istraživači upozoravaju da postizanje "pravog razumijevanja jezika" ostaje jedan od najvažnijih izazova u razvoju AI sistema koji mogu vjerodostojno modelirati ljudsko razmišljanje.

Naša perspektiva: šta ovo znači za vas koji koristite AI

Za poslovne korisnike u regionu koji se oslanjaju na AI za donošenje odluka, ova istraživanja su konkretno upozorenje.

AI alati (ChatGPT, Claude, Gemini) mogu vam dati odgovor koji zvuči savršeno, koristi pravu terminologiju i djeluje stručno. Ali to ne garantuje da je model "razumio" vaš specifičan kontekst. Možda je samo prepoznao obrazac sličan nečemu iz treninga i dao odgovor koji statistički odgovara tom obrascu.

Praktična pravila nikad ne prihvatajte AI odgovor bez provjere kad su u pitanju odluke sa stvarnim posljedicama. Finansijske analize, pravni savjeti, medicinske informacije, sve to zahtijeva ljudsku verifikaciju. Ne zato što AI uvijek griješi, nego zato što ne možete znati kad griješi a zvuči uvjerljivo.

Analogija sa satom je savršena metafora: AI koji rješava olimpijsku matematiku ali ne čita sat, ne znate unaprijed koji zadatak je "olimpijska matematika" a koji je "analogni sat" za vaš specifičan problem.

Zaključak

AI industrija voli da naglašava impresivne rezultate: zlatne medalje, rekordne benchmarkove, superljudske performanse. Ali Stanford AI Index i novo istraživanje o Centauru zajedno pokazuju drugu stranu: sposobnosti su neravnomjerne, razumijevanje je upitno, i tačan odgovor ne znači da je model razumio pitanje. Za korisnike, poruka je jasna: koristite AI kao moćan alat, ali nikad kao zamjenu za vlastito razmišljanje. Posebno ne kad je u pitanju nešto što zaista računa.

Šta dalje

Pratimo svaku ozbiljnu AI temu detaljno, analize, alati, workflow vodiči. Prijavi se na AI Balkan newsletter i dobij sve direktno u inbox.